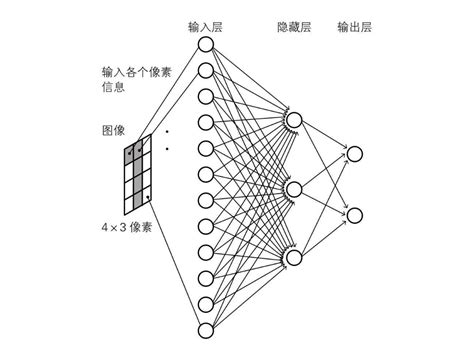

在神经网络模型中,嵌入层、隐藏层和输出层是三个关键的组成部分,各自承担着不同的功能。

嵌入层是神经网络的第一层,通常用于将输入数据(如文本或图像)转换为固定维度的向量表示。这种转换使得模型能够捕捉到输入数据的内在结构和语义信息,为后续处理打下基础。嵌入层可以将高维离散特征映射到低维连续空间中,以便于神经网络模型对这些特征进行学习。例如,在自然语言处理任务中,嵌入层可以将单词映射为词向量,从而捕捉单词之间的语义关系。

隐藏层位于输入层和输出层之间,是神经网络的核心部分。它们负责特征提取和信息处理,通过非线性变换将输入数据抽象到另一个维度空间,展现其更抽象化的特征。隐藏层的数量和层数可以根据具体任务的需求进行调整,多个隐藏层可以对输入特征进行多层次的抽象,从而更好地线性划分不同类型的数据。隐藏层通常包含多个神经元,并通过权重矩阵进行连接,这些权重在训练过程中不断调整以优化模型性能。

输出层是神经网络的最后一层,负责将前一层传递过来的特征向量进行处理并输出结果。输出层的设计需要根据具体的任务进行调整,以适应不同的应用场景。在分类任务中,输出层通常采用Softmax函数来计算每个类别的概率分布。输出层的主要作用是将模型的预测结果进行可视化,供我们进行分析和解读。此外,输出层还具有良好的鲁棒性和泛化性能,能够减少过拟合问题,提高模型的泛化能力。

嵌入层、隐藏层和输出层共同构成了神经网络的基本架构,各自承担着数据预处理、特征提取和结果输出的重要职责。

声明:文章均为AI生成,请谨慎辨别信息的真伪和可靠性!