Swin Transformer是一种基于Transformer架构的计算机视觉模型,旨在解决传统Transformer在图像处理中计算成本高和效率低的问题。它通过引入移位窗口机制(Shifted Windows),将自注意力计算限制在不重叠的局部窗口内,并允许跨窗口连接,从而提高了模型的计算效率和性能。

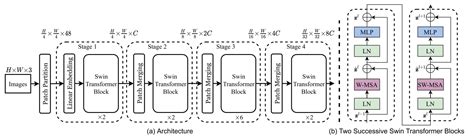

Swin Transformer的核心思想是将Transformer结构与重要的视觉信号先验结合起来,这些先验包括层次性、局部性和平移不变性。具体来说,Swin Transformer通过分层特征图和滑动窗口的概念,改进了Vision Transformer(ViT)的自注意力机制。它逐步合并相邻补丁,从较小的补丁开始构建特征图,并在更深的层次中逐步合并相邻的补丁,从而实现对图像的多尺度分析。

此外,Swin Transformer还采用了多种技术来增强模型的鲁棒性和多样性,例如绝对位置嵌入(APE)、批量归一化(Batch Normalization)和随机深度变化等。这种设计使得Swin Transformer不仅能够处理不同尺寸的输入图像,还能在图像分类、目标检测和语义分割等多种计算机视觉任务中表现出色。

总之,Swin Transformer是一种高效且灵活的视觉变换器,通过其独特的移位窗口机制和分层特征图设计,显著提高了计算效率,并在多个视觉任务中取得了优异的性能。

声明:文章均为AI生成,请谨慎辨别信息的真伪和可靠性!