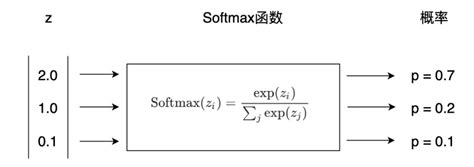

Softmax分类器是一种用于多分类任务的模型,其核心思想是将神经网络输出层的原始分数(logits)通过Softmax函数转换为概率分布,从而输出每个类别的概率值。以下是关于Softmax分类器的详细解释:

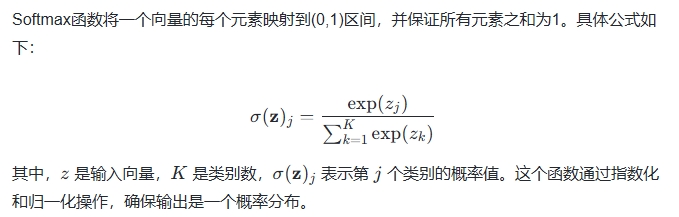

1. Softmax函数的定义

2. Softmax分类器的工作原理

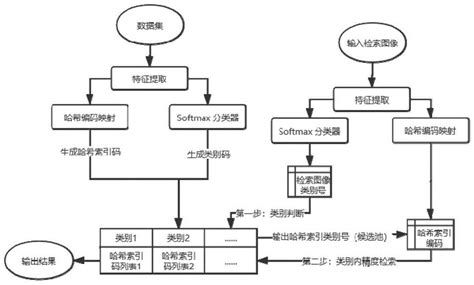

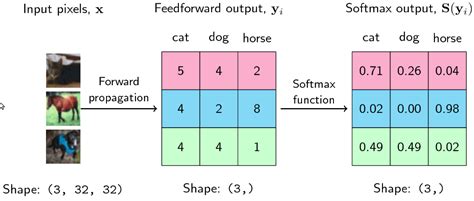

Softmax分类器通常作为神经网络的最后一层,用于处理多分类问题。其工作流程如下:

- 线性变换:输入数据通过神经网络的前几层(如卷积层、全连接层等)进行线性变换,得到一个向量 z,称为logits。

- Softmax函数:将logits输入到Softmax函数中,将其转换为概率分布。

- 预测与损失计算:根据概率分布预测类别,并使用交叉熵损失函数(Cross-Entropy Loss)衡量预测概率与真实标签之间的差异。

3. Softmax分类器的特点

- 多分类能力:Softmax分类器适用于多分类问题,能够同时处理多个类别的预测。

- 概率输出:输出是一个概率分布,每个类别的概率值之和为1,便于解释和决策。

- 数值稳定性:为了避免指数运算导致的数值溢出问题,通常会对logits进行减去最大值的操作(即softmax归一化技巧)。

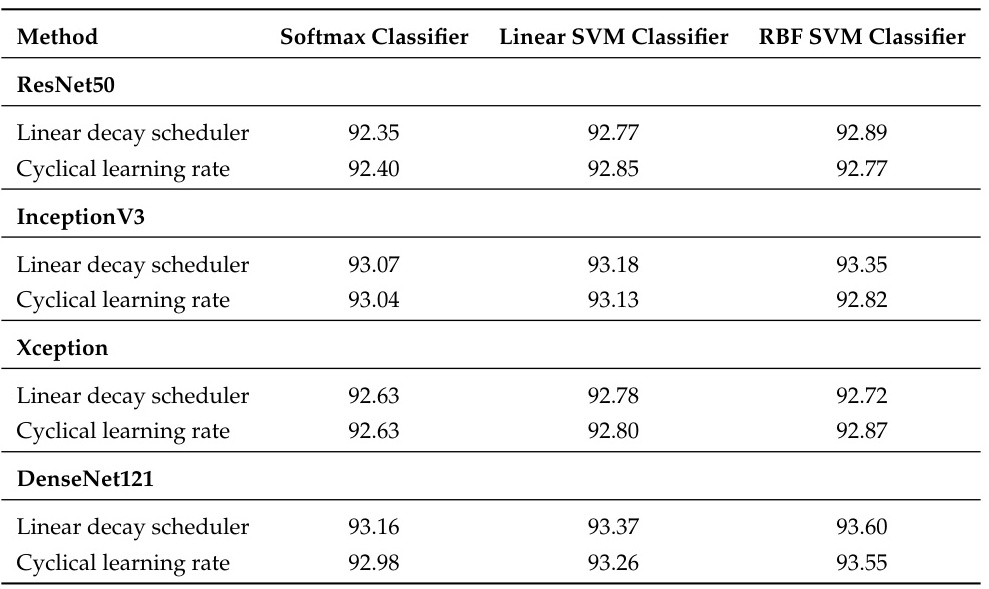

- 与SVM的区别:与支持向量机(SVM)相比,Softmax分类器通过交叉熵损失函数优化,而SVM使用的是拉格朗日对偶问题。

4. 应用场景

Softmax分类器广泛应用于各种多分类任务中,包括但不限于:

- 图像分类:如ImageNet竞赛中的深度卷积神经网络(CNN)使用Softmax分类器进行图像分类。

- 自然语言处理(NLP) :在文本分类、情感分析等任务中,Softmax分类器用于输出每个类别的概率。

- 医学诊断:如轴承故障诊断中使用Softmax分类器对不同故障类别进行预测。

5. 优化与改进

为了提高Softmax分类器的性能,研究者提出了多种改进方法:

6. 优缺点

优点:

- 输出概率分布直观易懂。

- 能够处理多分类问题。

- 数值稳定,避免了直接计算指数的溢出问题。

缺点:

- 参数冗余:由于需要为每个类别维护一个权重向量,导致参数量较大。

- 对不平衡数据敏感:当类别分布不均匀时,可能会导致某些类别的预测性能下降。

7. 总结

Softmax分类器是深度学习中一种重要的多分类模型,通过Softmax函数将神经网络的输出转化为概率分布,从而实现对多个类别的预测。其广泛应用于图像识别、自然语言处理等领域,并通过多种优化技术进一步提升性能。然而,在实际应用中,需要根据具体任务选择合适的优化策略和改进方法。

声明:文章均为AI生成,请谨慎辨别信息的真伪和可靠性!