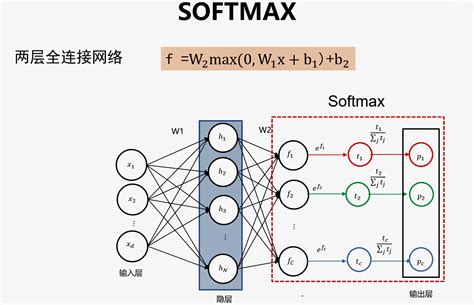

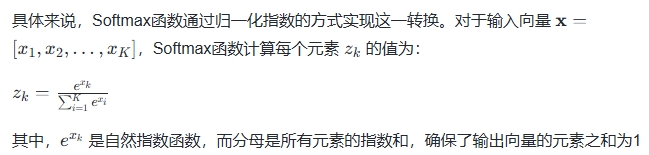

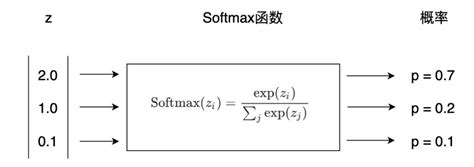

Softmax函数是一种在机器学习和深度学习中广泛应用的数学函数,主要用于多分类问题中的输出层。它的主要作用是将一个含有任意实数的K维向量转换为另一个K维的实数向量,使得每个元素的值在0到1之间,并且所有元素的总和为1,从而形成一个概率分布。

Softmax函数可以看作是逻辑函数(Sigmoid函数)在多分类任务上的推广,它将线性预测值转化为类别概率,从而使得模型的输出可以解释为各个类别的概率。这种函数形式不仅有助于提高分类准确性,还便于使用交叉熵损失函数进行优化。

此外,Softmax函数在硬件实现中也得到了关注,因为其计算涉及指数和除法操作,这些操作在硬件上可能较为复杂。因此,研究者们提出了多种优化方法来提高计算效率。

声明:文章均为AI生成,请谨慎辨别信息的真伪和可靠性!