通道剪枝(Channel Pruning)是一种深度学习模型压缩技术,主要用于减少神经网络的计算复杂度和存储需求,同时尽量保持模型的性能。通道剪枝的核心思想是移除卷积神经网络中不重要的通道,即滤波器或特征图,从而简化模型结构并降低资源消耗。

通道剪枝的基本概念

- 定义:通道剪枝是指在卷积神经网络中,通过移除某些卷积核的某些通道(即特征图),从而减少整个卷积层的参数量和计算量。

- 应用场景:通道剪枝可以应用于训练好的模型,用于推理阶段的加速和部署,特别是在资源受限的设备上运行时非常有效。

- 目标:通过剪枝操作,减少模型的冗余部分,同时尽量减少对模型性能的影响,甚至可以通过微调进一步提升性能。

剪枝方法

通道剪枝的方法可以分为以下几种:

- 基于权重的重要性评估:

- 基于冗余度和相关性的评估:

- 基于重建误差的方法:

- 通过最小化重建误差来评估通道的重要性。例如,DCP算法通过计算剪枝前后特征图之间的欧几里得距离来衡量重建误差。

- 另一种方法是通过添加区分损失函数来强化中间层的判别能力,并考虑特征重建误差。

- 基于经验规则的方法:

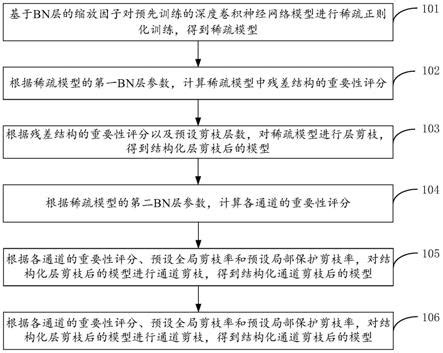

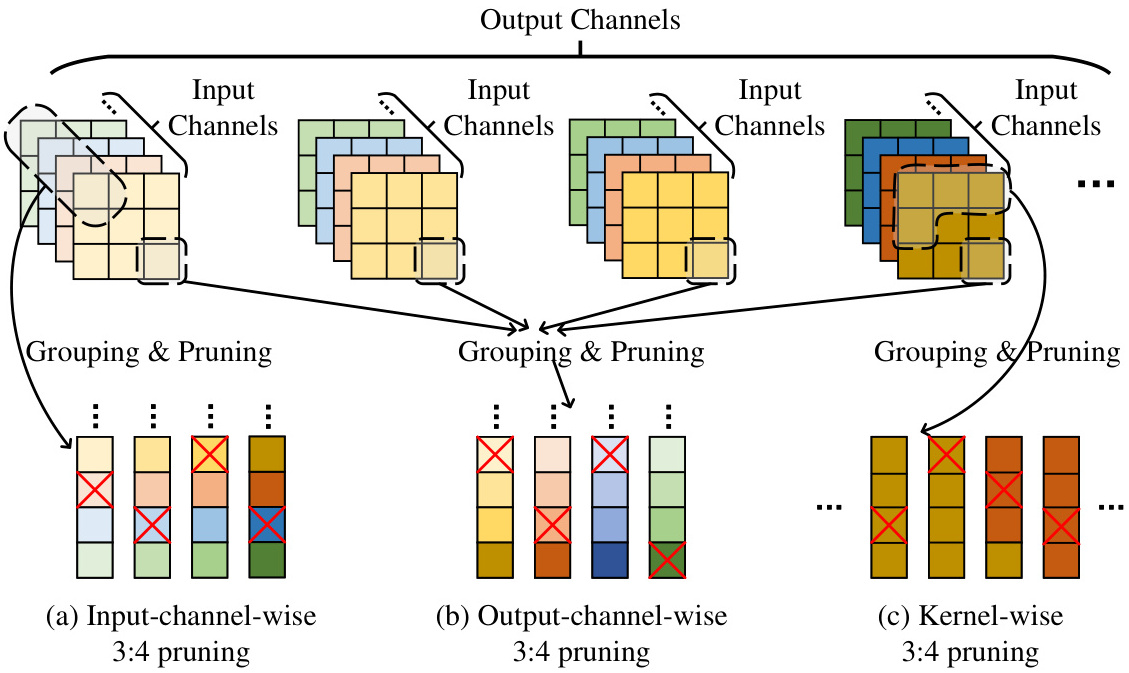

- 根据经验规则选择剪枝比例或直接裁剪特定比例的通道。例如,输入通道、输出通道或核输入通道可以按照固定比例进行剪枝。

- 混合策略:

剪枝步骤

通道剪枝通常包括以下步骤:

- 训练原始模型:首先训练一个完整的深度神经网络模型。

- 评估通道重要性:根据上述方法评估每个通道的重要性。

- 选择并剪枝通道:根据预定义的剪枝比例或重要性阈值选择要剪枝的通道。

- 重建特征图:通过最小化重建误差来调整剩余通道的参数,以弥补因剪枝带来的性能损失。

- 微调模型:对剪枝后的模型进行微调,以恢复或提升性能。

剪枝的优势与挑战

优势:

- 显著降低模型的计算复杂度和存储需求。

- 提高模型在边缘设备上的运行效率。

- 在某些情况下,通过微调甚至可以提升模型性能。

挑战:

- 剪枝后可能导致模型性能下降,需要通过微调来恢复。

- 如何平衡剪枝比例与模型性能之间的关系是一个关键问题。

- 剪枝后的模型可能需要重新训练以适应新的任务或数据集。

实际应用案例

- YOLOv4:通过输入、输出和核输入通道的3:4比例剪枝,实现了显著的参数量减少和计算效率提升。

- ViT:使用不同的通道剪枝方法(如LFS、ATME等),在保持较高准确率的同时大幅减少了FLOPs和延迟。

- CNN加速器:通过输入、输出和核输入通道的剪枝,实现了高效的CNN加速器设计。

总结

通道剪枝是一种有效的深度学习模型压缩技术,通过移除不重要的通道来减少模型的计算复杂度和存储需求。其核心在于如何准确评估通道的重要性,并通过合理的策略进行剪枝和微调。尽管存在一定的挑战,但随着技术的发展,通道剪枝在实际应用中展现了巨大的潜力

声明:文章均为AI生成,请谨慎辨别信息的真伪和可靠性!