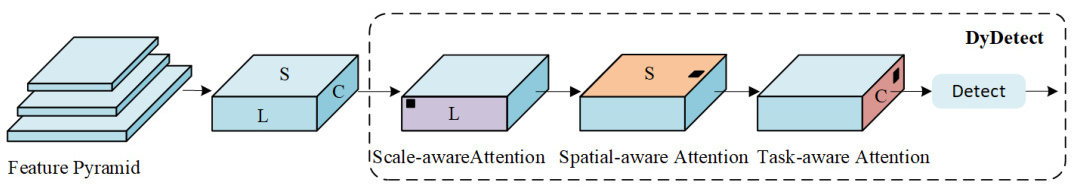

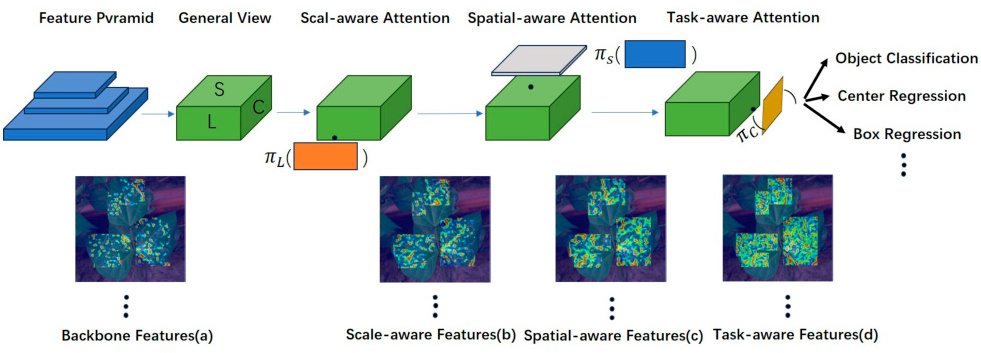

尺度感知注意力(Scale-aware Attention)是一种在深度学习模型中用于增强特征表示能力的注意力机制,主要应用于目标检测、图像分割等任务中。其核心思想是通过动态调整不同尺度特征的权重,使模型能够更好地捕捉目标在不同尺度下的特征信息。

核心原理

- 尺度感知的定义:

尺度感知注意力模块通常部署在特征金字塔的层级维度上,通过学习目标特征在不同尺度下的变化规律,增强模型对目标大小的敏感性。例如,在目标检测任务中,不同大小的目标需要不同的尺度特征来描述其语义信息。 - 实现方式:

- 应用场景:

技术细节

- 特征金字塔的作用:

特征金字塔通过多层卷积和上采样/下采样操作,生成不同分辨率的特征图。这些特征图包含了从全局到局部的信息,为后续的注意力模块提供了丰富的输入。 - 注意力机制的优化:

尺度感知注意力模块通常结合了自注意力机制、可变形卷积等技术。例如,通过级联卷积操作和深度可分离卷积,避免了过拟合问题,同时提高了计算效率。 - 动态调整权重:

尺度感知注意力模块通过学习特征图中不同尺度的权重分布,动态调整特征的重要性。例如,在CSP模块中,通过通道-空间联合注意力机制,增强了目标提取的有效性。

实验结果

多项研究表明,引入尺度感知注意力模块可以显著提升模型的性能。例如,在COCO数据集上,DyHead框架通过引入尺度感知注意力模块,AP性能提升了2.9点。此外,在显微图像分割任务中,尺度感知注意力模块通过显式的注意力机制,改善了区域定位的准确性。

总结

尺度感知注意力是一种通过动态调整不同尺度特征权重的注意力机制,能够显著提升模型在目标检测、图像分割等任务中的性能。其核心在于利用特征金字塔生成多尺度特征,并通过自注意力机制或可变形卷积等技术,增强模型对目标在不同尺度下的识别能力。这一技术已经在多个领域得到了广泛应用,并取得了显著的效果

声明:文章均为AI生成,请谨慎辨别信息的真伪和可靠性!